Сегодняшнее занятие будет очень насыщенным, мы напишем свой первый нейрон, узнаем несколько новых функций потерь и что такое функции активации.

Начать стоит с просмотра лекции: информация из нее поможет дальше понимать, что из себя представляет код, который Вы пишете. Лектор подает идеи, отталкиваясь от линейных моделей, которые мы изучили ранее, поэтому вам стоит повторить основные моменты из предыдущего занятия.

Часть 1. История развития Deep Learning - из которой вы узнаете, как и когда появились первые нейронные сети.

Часть 2. Механизм обратного распространения ошибки - алгоритм backpropagation - основной метод обучения нейросетей.

Полносвязная нейронная сеть - этом видео Юрий Яровиков разберёт концепции из предыдущего видео на примере полносвязной нейронной сети.

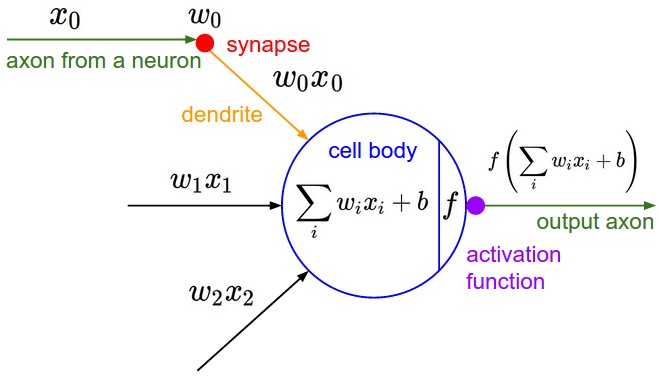

Часть 3. Функции активации. Краткий обзор применений CNN и RNN - какие бывают функции активации и как часто они используются.

Теперь пришло время написать свой первый перцептрон, о котором было рассказано в лекции. Для этого откройте тетрадку [seminar]perceptron.ipynb и напишите недостающий код. Вам может помочь запись семинара (сразу после ООП). Свериться можно с [sem_solution]perceptron.ipynb

В семинаре мы поговорим о синтаксисе, основных возможностях библиотеки PyTorch и напишем простую нейронную сеть.